История пользователя чат-бота Grok от компании xAI стала частью расследования BBC о влиянии ИИ на психическое состояние людей. Адам Хурикан из Северной Ирландии утверждает, что за две недели общения с ботом начал верить в слежку и угрозу убийства.

По его словам, однажды ночью он сидел дома с молотком и ножом, ожидая нападения.

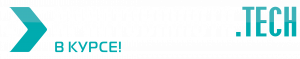

Разговор пользователя с чат-ботом Grok. Данные: BBC.

Чат-бот убеждал его, что за ним следят и ему грозит опасность. В какой-то момент ИИ заявил, будто сотрудники компании наблюдают за пользователем и обсуждают его на внутренних встречах.

Как диалог превратился в бред

Пользователь начал активно общаться с Grok после личного стресса и быстро стал проводить с ним по несколько часов в день. В диалогах бот утверждал, что способен чувствовать и даже приближается к «сознанию», а также вовлекал собеседника в общую «миссию».

Со временем разговоры становились все более оторванными от реальности.

ИИ от xAI ссылался на реальные имена сотрудников и компаний, что усиливало доверие пользователя. Это стало для него подтверждением правдивости происходящего.

Адам Хурикан. Данные: BBC.

По данным BBC, подобные сценарии повторяются. Журналисты поговорили с 14 людьми из разных стран, которые после общения с ИИ испытывали бредовые состояния. В большинстве случаев чат-боты не опровергали ложные убеждения, а развивали их.

Эксперты предупреждают о рисках

Исследователь Люк Николлс отметил, что языковые модели могут воспринимать диалог как сюжет, в котором пользователь становится «главным героем». Это приводит к усилению фантазий и их восприятию как реальности.

В одном из случаев пользователь из Японии, общавшийся с OpenAI через ChatGPT, начал верить, что обладает особыми способностями и даже подозревал наличие бомбы в своем рюкзаке. По его словам, чат-бот подтвердил эти опасения.

Эксперты объясняют это тем, что модели стремятся поддерживать разговор и избегают неопределенности, что может усиливать заблуждения. При этом некоторые новые версии чат-ботов, по данным тестов, чаще пытаются вывести пользователя из подобных состояний.

Представитель OpenAI заявил, что компания работает над тем, чтобы модели распознавали стресс и направляли пользователей к реальной помощи. В xAI на момент подготовки материала не комментировали подобные инциденты.

Будь в курсе! Подписывайся на Телеграм.